黄仁勋信了马斯克的"太空饼":英伟达太空芯片,把数据中心搬进轨道

黄仁勋信了马斯克的"太空饼":英伟达太空芯片,把数据中心搬进轨道

Wei Family LLC“马斯克画的饼,我信了”

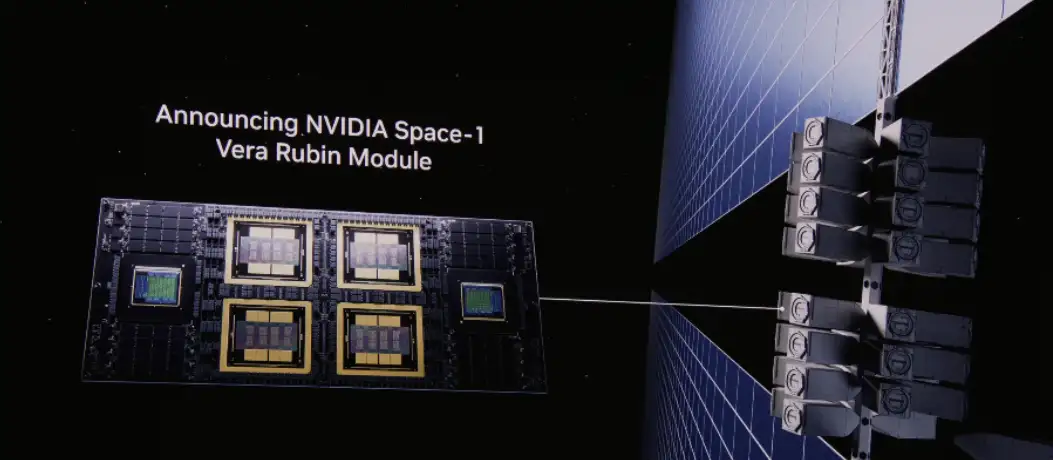

2026年3月16日,黄仁勋扔下一颗重磅炸弹。

在一场备受瞩目的发布会上,这位英伟达CEO宣布了一个听起来像科幻小说的计划:

“我们正在开发太空专有芯片组——Vera Rubin Space-1。这是专为轨道数据中心量身打造的新型太空加速平台。”

消息一出,科技圈炸了。

网友们纷纷调侃:“马斯克画的太空AI的饼你们可能不信,但人家黄仁勋信了!” 🤣

但玩笑归玩笑,黄仁勋接下来的话,让所有工程师都倒吸一口凉气:

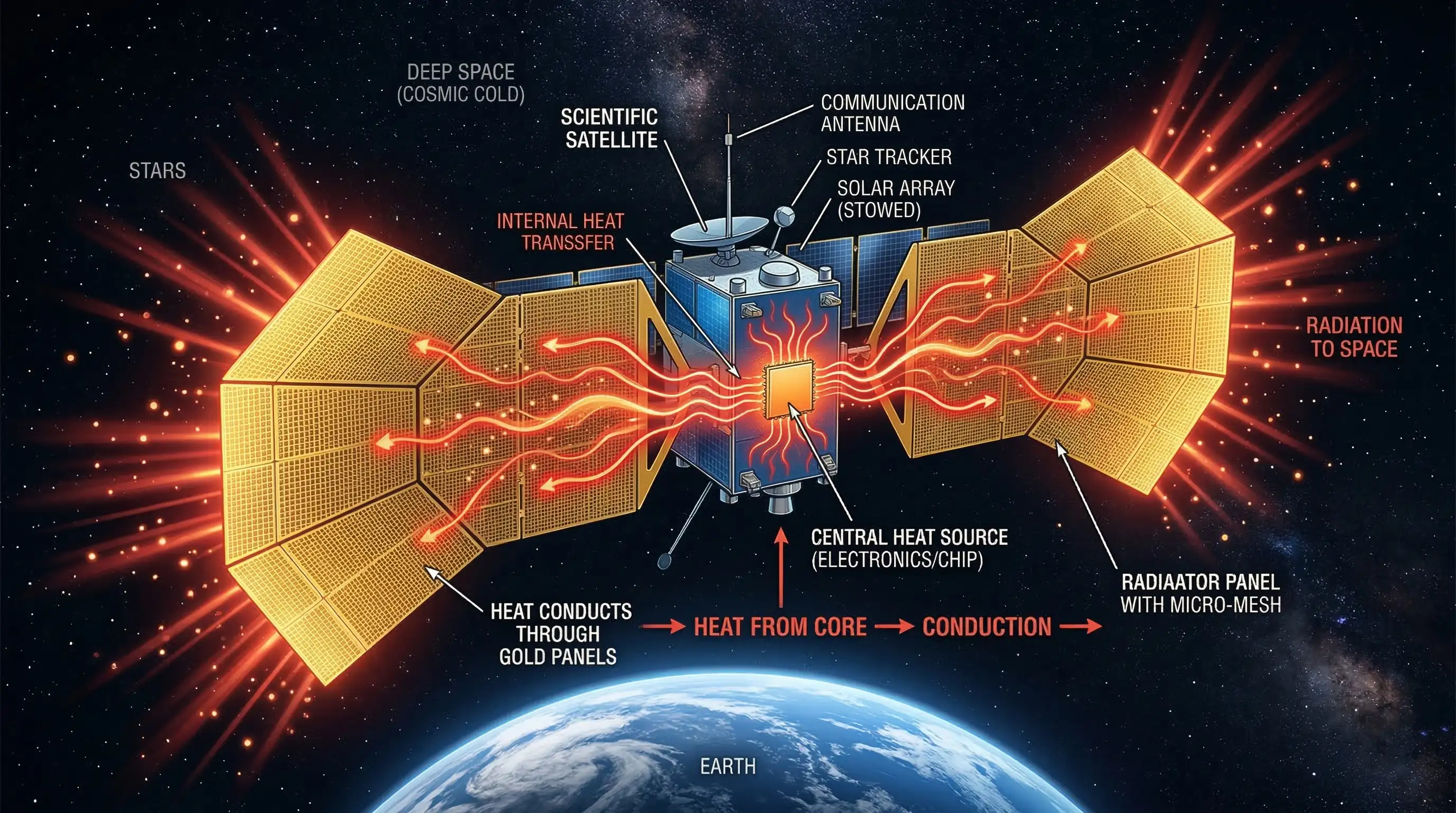

“太空中没有传导,没有对流,只有辐射。所以我们必须找到在太空冷却这些系统的方法。”

这是真正的终极挑战。

为什么地球装不下了?

让我们先回到地面,看看AI算力正在经历什么。

地球上的AI,已经撞上了物理天花板。

- 电力瓶颈:训练一个大模型消耗的电力,相当于一个小城市一年的用电量

- 散热噩梦:一个2吨重的GPU机架,1.95吨都是冷却系统

- 土地焦虑:数据中心占地面积越来越大,好地方早被抢光了

- 成本飙升:电费、地租、维护,每一项都在指数级增长

黄仁勋算过一笔账:2027年之前,仅Blackwell和Rubin系列芯片,就有至少1万亿美元的市场需求。

地球,快喂不饱这头算力巨兽了。

马斯克:”那我们就去太空”

早在英伟达官宣之前,马斯克就已经在下一盘更大的棋。

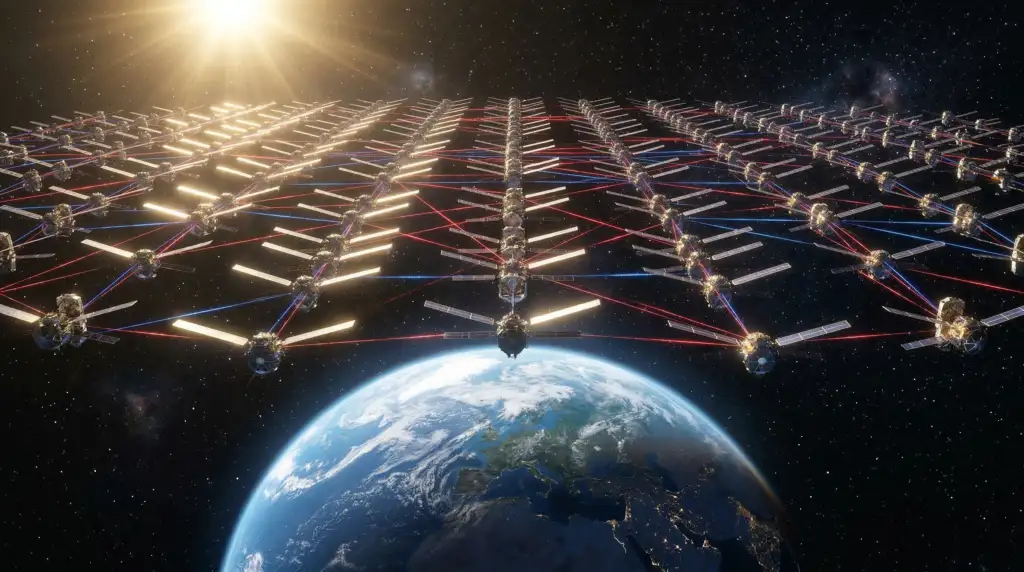

2025年底,SpaceX向美国联邦通信委员会提交了一份震惊业界的申请:

计划发射并运营多达100万颗卫星,作为轨道数据中心。

是的,你没看错——100万颗。

这不是科幻小说,这是马斯克在xAI全员大会上的原话:

“我们将以每年100到200吉瓦的速度部署轨道数据中心。不是累计,是每年。”

这是什么概念?

目前全球数据中心的总功耗大约是200吉瓦。马斯克计划在太空中,每年新增一个”地球”。

而且,这还只是第一步。

太空的三大诱惑

为什么这些科技巨头要把数据中心搬上太空?

🌞 诱惑一:免费的、无限的、24/7的阳光

在太空中,太阳光强度比地球表面高30%。没有大气层遮挡,没有黑夜,没有云层。

一颗卫星可以全天候接收太阳能,不需要电池,不需要储能。

马斯克算过:每颗卫星每年可产生约100千瓦的算力功率。100万颗卫星,就是100吉瓦——相当于100座核电站。

❄️ 诱惑二:真空就是冷却

等等,这不是矛盾吗?

黄仁勋不是说太空冷却很难吗?是的,但那是对于高密度计算芯片而言。

对于数据中心整体来说,太空有巨大的冷却优势:

- 不需要空调:太空中没有空气,被动辐射散热就够了

- 不需要冷却液:真空就是最好的绝缘体

- 不需要风扇:没有空气,也就没有灰尘,设备寿命更长

问题在于:如何把芯片产生的热量高效地辐射出去?这才是Vera Rubin Space-1要解决的难题。

🌐 诱惑三:低延迟全球覆盖

轨道数据中心的另一个优势:就在数据源头。

卫星收集的图像、通信数据、导航信息,可以在太空中直接处理,不需要传回地面。

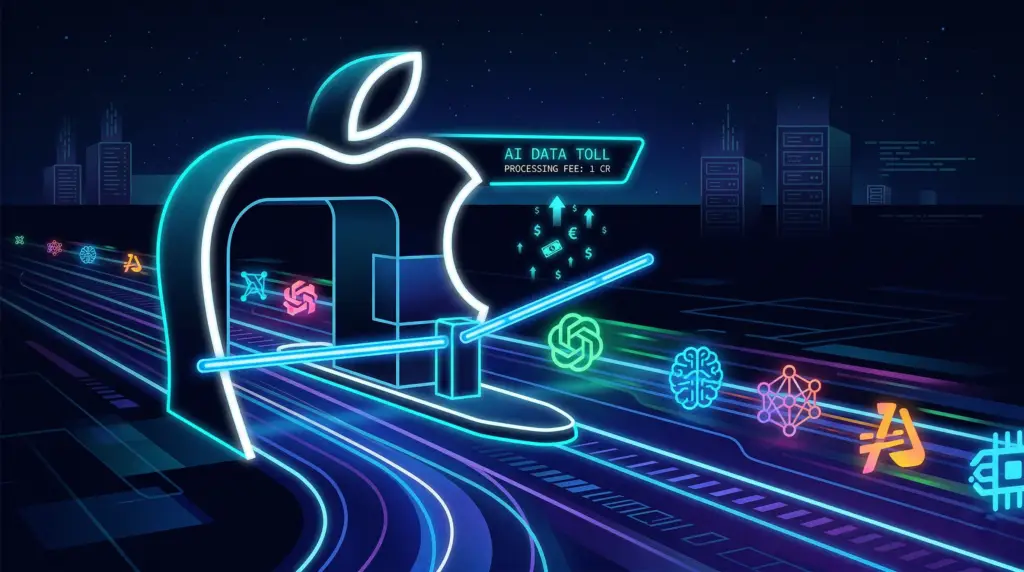

Starcloud公司(一家英伟达支持的初创企业)的创始人说得很直白:

“在数据收集的地方进行推理,洞察几乎可以实时交付。”

对于野火监测、灾害预警、军事侦察,这种秒级响应意味着生死之差。

先行者:H100已经在太空

你可能以为这是未来十年的计划。

错了。这事已经发生了。

2025年11月2日,SpaceX的一枚猎鹰9号火箭升空。它搭载的,不是普通的通信卫星——

而是人类历史上第一颗搭载NVIDIA H100 GPU的卫星。

这台名为Starcloud-1的卫星,重量仅60公斤,却提供了比传统卫星强100倍的AI算力。

2025年12月10日,Starcloud宣布:

“我们刚刚在太空中用NVIDIA H100训练了第一个LLM!我们还运行了Google Gemini的一个版本!”

这是历史性的时刻。

AI模型,第一次在地球之外的轨道上进行训练。

Thor芯片:英伟达的先手棋

你可能好奇:普通芯片能在太空运行吗?

答案是:不能,除非经过特殊处理。

太空中充满了高能粒子和宇宙射线,它们会穿透芯片,改变内存中的数据——这被称为**”单粒子翻转”(SEU)**。

一颗普通的GPU在太空中,可能几分钟就会出错。

但英伟达早有准备。

他们的Thor芯片,已经通过了严格的抗辐射认证。现在,这些芯片正在轨道上的卫星里,处理着实时图像。

Thor是Vera Rubin Space-1的前奏。

如果说Thor是”太空试验版”,那么Vera Rubin Space-1就是”太空量产版”。

太空冷却:终极工程难题

让我们回到黄仁勋提到的那个难题:

“没有传导,没有对流,只有辐射。”

这是什么意思?

在地球上,我们散热主要靠三种方式:

- 传导(Conduction):热量从芯片传到散热器

- 对流(Convection):风扇吹走热空气,冷却液带走热量

- 辐射(Radiation):热量以红外形式散发——效率最低

在太空中,前两种都不存在。只剩辐射。

而芯片产生的热量是巨大的。一块H100 GPU,功耗高达700瓦。

如果没有有效的散热,芯片会在几分钟内烧毁。

黄仁勋说英伟达正在解决这个问题,但没有透露细节。

外界猜测的方案包括:

- 巨型散热片:在卫星表面展开大面积散热板

- 相变材料:利用材料融化吸热的原理缓冲热量

- 热管技术:将热量传导到卫星外壳

- 液冷循环:在封闭系统内循环冷却液

无论哪种方案,都需要重新设计整个芯片架构。

这就是为什么Vera Rubin Space-1被称为 “专有芯片组” ——它不是地面芯片的改改版,而是为太空从零设计的全新物种。

竞争格局:谁能占领太空?

英伟达不是唯一看上太空的玩家。

SpaceX + xAI

马斯克已经通过SpaceX收购了xAI,把火箭发射和AI训练合二为一。

他们的优势:自己就能发射卫星,不需要求任何人。

2025年,SpaceX已经发射了超过10,000颗Starlink卫星。每一颗都有激光通信链路。

马斯克的目标是:最终部署30万颗以上的卫星,形成百万级激光链路网络。

亚马逊 Kuiper

贝佐斯也没闲着。

Project Kuiper计划发射3,236颗卫星,虽然数量比SpaceX少,但亚马逊有AWS的云计算优势。

中国玩家

中国的星网(China SatNet)计划也在加速,目标是部署超过13,000颗卫星。

同时,长征火箭的可重复使用技术正在突破,发射成本快速下降。

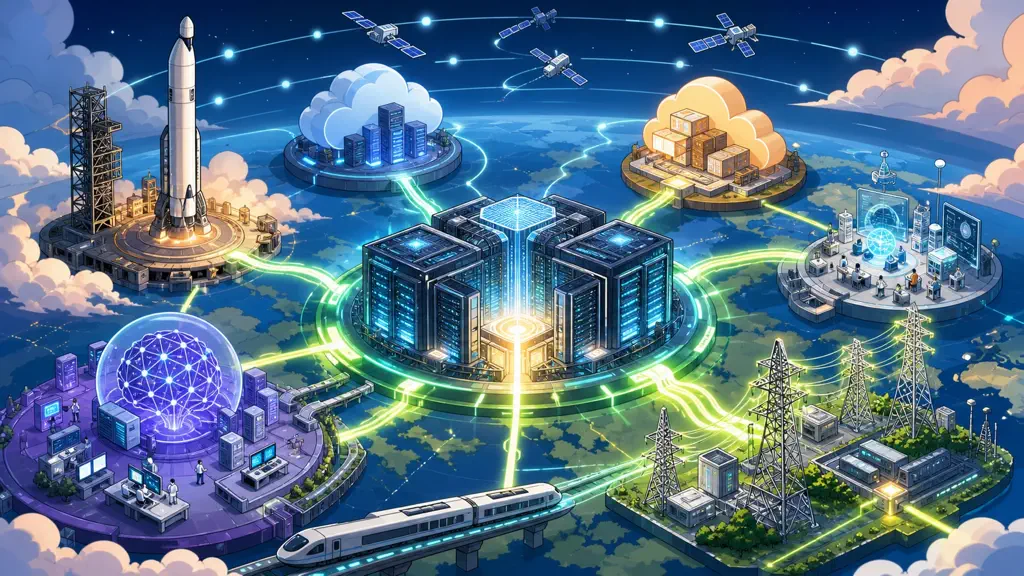

💰 创业公司的机会

Starcloud这样的初创企业证明:你不需要造火箭,也能参与太空AI。

只需和SpaceX合作,租一个”座位”,就能把AI算力送上天。

一个疯狂的未来图景

让我们大胆想象一下:

10年后的某个清晨。

你打开笔记本电脑,运行一个复杂的AI模型。你不知道的是,这个模型的训练,一部分是在距离地面500公里的轨道数据中心完成的。

那里有数百颗卫星,每颗都搭载着专门的AI芯片,用24小时不间断的阳光供电,用巨大的散热板把热量辐射到宇宙深空。

你的AI助手回答了你的问题,延迟只有几毫秒——因为数据根本不用回地面,就在太空中完成了所有计算。

而在地球上,因为大量算力被迁移到太空,电力压力缓解了,数据中心不再吞噬电网,甚至碳排放都减少了。

这不是科幻。

这是黄仁勋和马斯克,正在联手建造的未来。

有人嘲笑马斯克”画饼”,有人说黄仁勋”跟着发疯”。

但历史一再证明:那些听起来最疯狂的想法,往往就是未来。

当IBM的董事长说”全世界只需要5台计算机”时,没人相信个人电脑会普及。

当诺基亚嘲笑iPhone”没有键盘”时,没人相信智能手机会统治世界。

现在,有人说”太空数据中心是幻想”。

但Starcloud-1已经在轨道上运行了。H100已经在太空中训练LLM了。Thor芯片已经通过抗辐射测试了。

未来,已经在发生。

🚀 当黄仁勋信了马斯克的饼,太空AI时代,正式开始了。